Obecne centra danych AI borykają się z dwoma głównymi wąskimi gardłami w skalowaniu, a tradycyjne modele-skalowane w górę i wszerz-z trudem spełniają wymagania AI w skali giga{2}}:

Ograniczenia skali-w górę: osiągnięty poprzez modernizację pojedynczych systemów lub szaf (np. zwiększenie liczby procesorów graficznych lub poprawę wydajności pojedynczego-urządzenia), ale ograniczony przez pułapy mocy infrastruktury, takiej jak chłodzenie wodne. Istniejące centra danych mają fizyczne progi poboru mocy i rozpraszania ciepła, co zapobiega nieskończonemu wzrostowi gęstości obliczeniowej na szafę lub centrum danych.

Ograniczenia-skalowania: Rozszerzony poprzez dodanie szaf i serwerów w celu skalowania klastrów, ale ograniczony przez przestrzeń fizyczną w jednym miejscu, co narzuca sztywne ograniczenia wydajności sprzętu.

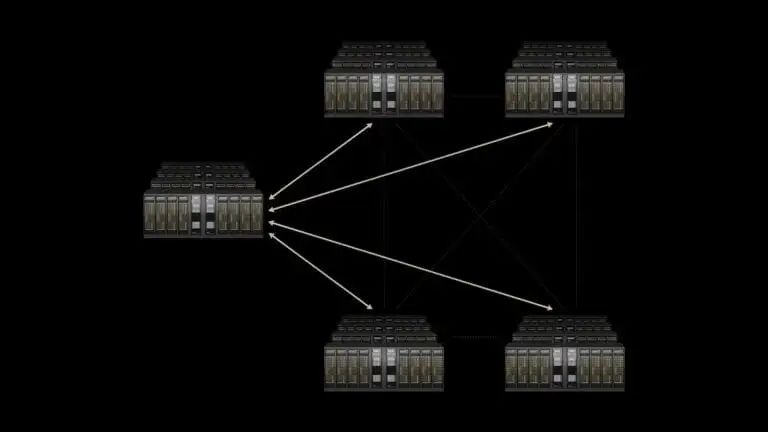

Aby przezwyciężyć ten dylemat, NVIDIA proponuje nowy wymiar „skali-wszerz”, optymalizując komunikację sieciową pomiędzy geograficznie rozproszonymi centrami danych, aby rozproszone klastry AI współpracowały w jeden. Założyciel i dyrektor generalny firmy NVIDIA, Jensen Huang, opisuje tę międzyregionalną-superfabrykę sztucznej inteligencji jako kluczową infrastrukturę rewolucji przemysłowej sztucznej inteligencji, w której Spectrum-XGS jest głównym czynnikiem umożliwiającym rozwój technologii.

Podstawowe technologie widma-XGS

Spectrum-XGS nie jest całkowicie nową platformą sprzętową, ale ewolucją istniejącego ekosystemu Spectrum-X Ethernet firmy NVIDIA. Od premiery w 2024 r. Spectrum-X zapewnia 1,6 razy wyższą wydajność sieci generatywnej AI w porównaniu z tradycyjnym Ethernetem dzięki przełącznikom SN5600 i procesorom DPU BlueField-3 architektury Spectrum-4, stając się głównym wyborem dla centrów danych AI korzystających z procesorów graficznych NVIDIA. Przełom w Spectrum-XGS polega na trzech innowacjach algorytmicznych i synergii sprzętowej, które rozwiązują problemy związane z opóźnieniami w komunikacji, przeciążeniami i synchronizacją w międzyregionalnych klastrach GPU.

1. Algorytmy podstawowe: dynamiczna adaptacja do charakterystyki sieci-dużego zasięgu

Rdzeniem Spectrum-XGS jest zestaw „algorytmów optymalizacji sieci uwzględniających{{1} odległość”, które analizują w czasie rzeczywistym kluczowe parametry komunikacji między-centrami danych-(odległość, wzorce ruchu, poziomy zatorów, wskaźniki wydajności) i dynamicznie dostosowują zasady sieciowe:

Odległość-Adaptacyjna kontrola zatorów:W przeciwieństwie do jednolitego traktowania wszystkich połączeń w tradycyjnej sieci Ethernet, algorytmy Spectrum-XGS automatycznie dostosowują progi zatorów na podstawie rzeczywistych odległości między centrami danych (obecnie obsługują wdrożenia do setek kilometrów), unikając utraty lub gromadzenia pakietów w-transmisjach na duże odległości.

Precyzyjne zarządzanie opóźnieniami:Dzięki drobnoziarnistemu-routowaniu adaptacyjnemu na każdy pakiet eliminuje wahania związane z opóźnieniami wynikające z retransmisji pakietów w tradycyjnych sieciach. Jitter stanowi krytyczne zagrożenie w klastrach AI: jeśli pojedynczy procesor graficzny ma opóźnienia z powodu opóźnienia, wszystkie współpracujące procesory graficzne muszą poczekać, co bezpośrednio wpływa na ogólną wydajność.

Od końca-do{1}}końca telemetrii: Gromadzenie w czasie rzeczywistym-pełnych-danych dotyczących wydajności łączy z procesorów graficznych do przełączników i łączy-danych-centrów danych zapewnia informacje zwrotne na poziomie milisekund-na potrzeby korekt algorytmicznych, zapewniając dynamiczne dopasowanie stanu sieci do wymagań obciążenia AI.

2. Synergia sprzętowa: wykorzystanie widma-Podstawa wysokiej przepustowości ekosystemu X-

Spectrum-XGS osiąga optymalną wydajność w połączeniu z określonym sprzętem NVIDIA:

Przełączniki widma-X: jako podstawowy szkielet sieci, zapewniający dużą gęstość portów i przekazywanie o małych-opóźnieniach.

ConnectX-8 SuperNIC: Dedykowana karta sieciowa-AI 800 Gb/s do-szybkiego przesyłania danych pomiędzy procesorami graficznymi i przełącznikami.

Sprzęt architektury Blackwell: takie jak procesory graficzne B200 i superchipy GB10, głęboko zintegrowane ze Spectrum-XGS w celu zmniejszenia-końcowych-opóźnień. Firma NVIDIA zweryfikowała testy porównawcze NCCL (zbiorowa biblioteka komunikacyjna): Spectrum-XGS zwiększa wydajność komunikacji pomiędzy procesorami graficznymi-danych-centralnymi-o 1,9 razy, kontrolując jednocześnie-końcowe opóźnienie-na poziomie około 200 milisekund-na poziomie, który działa szybko i nie powoduje opóźnień w interakcjach z użytkownikiem,-spełniając wymagania w czasie rzeczywistym dotyczące wnioskowania AI.

Pełna-optymalizacja stosu pod kątem efektywnego uczenia AI i wnioskowania w widmie-XGS

Spectrum-XGS nie jest odrębną technologią, ale kluczowym dodatkiem do pełnego-ekosystemu sztucznej inteligencji firmy NVIDIA. W tej wersji firma NVIDIA ujawniła także ulepszenia wydajności-na poziomie oprogramowania, które współdziałają ze Spectrum-XGS w zakresie-algorytmu-sprzętu do współpracy w oprogramowaniu:

Aktualizacja oprogramowania Dynamo: Zoptymalizowany pod kątem architektury Blackwell (np. systemów B200) w celu zwiększenia wydajności wnioskowania o modelu AI nawet czterokrotnie, znacznie zmniejszając zużycie mocy obliczeniowej w przypadku wnioskowania o dużych modelach.

Technologia dekodowania spekulatywnego: wykorzystuje model w wersji roboczej, aby z wyprzedzeniem przewidzieć następny token wyjściowy głównego modelu sztucznej inteligencji, redukując obliczenia głównego modelu i zwiększając wydajność wnioskowania o dodatkowe 35%. Jest to szczególnie przydatne w przypadku scenariuszy wnioskowania konwersacyjnego w dużych modelach językowych (LLM).

Dyrektor działu obliczeń przyspieszonych firmy NVIDIA, Dave Salvator, stwierdził, że głównym celem tych optymalizacji jest skalowanie ambitnych aplikacji agentowych AI. Niezależnie od tego, czy szkolisz duże modele o bilionach-parametrów, czy też wspierasz usługi wnioskowania AI dla milionów jednoczesnych użytkowników, połączenie Spectrum-XGS i ekosystemu oprogramowania zapewnia przewidywalną wydajność.

Wczesne zastosowania i wpływ widma na branżę-XGS

Pierwsi użytkownicy: Pionierzy CoreWeave przekraczają-Domenę AI Super FactoryDostawca usług w chmurze dla procesorów graficznych, CoreWeave, jest jednym z pierwszych użytkowników Spectrum-XGS. Współzałożyciel firmy-i dyrektor ds. technicznych, Peter Salanki, zauważył, że technologia ta umożliwi jej klientom dostęp do możliwości sztucznej inteligencji-gigaskiej skali, przyspieszając przełomowe osiągnięcia w różnych branżach. Na przykład wspieranie-dużych-projektów AI, takich jak inicjatywa Stargate firm Oracle, SoftBank i OpenAI.

Trendy branżowe: Ethernet zastępuje InfiniBand w głównym nurcie sieci AIChociaż w 2023 r. InfiniBand posiadał około 80% rynku sieci typu backend AI, branża szybko przechodzi na Ethernet. Decyzja firmy NVIDIA o opracowaniu Spectrum-XGS w sieci Ethernet wpisuje się w ten trend:

Kompatybilność i zalety kosztowe:Ethernet to uniwersalny standard dla globalnych centrów danych, bardziej znany inżynierom sieciowym i tańszy we wdrożeniu niż InfiniBand.

Projekcje skali rynkowej:Dane Dell'Oro Group pokazują, że w ciągu najbliższych pięciu lat rynek przełączników Ethernet do centrów danych osiągnie prawie 80 miliardów dolarów.

Własny rozwój firmy NVIDIA: Raporty Grupy 650 wskazują firmę NVIDIA jako „najszybciej-rozwijającego się dostawcę” na rynku przełączników dla centrów danych w 2024 r., którego przychody z działalności sieciowej osiągnęły 5 miliardów dolarów w kwartale2 2024 (zakończonym 27 kwietnia), co oznacza wzrost o 56%-w stosunku- roku.

Wprowadzenie na rynek Spectrum-XGS rozszerza strategię firmy NVIDIA-w zakresie monopolu stosu w infrastrukturze sztucznej inteligencji, jednocześnie wywołując nową dynamikę konkurencyjności:

Pełny-układ stosu firmy NVIDIA: Od procesorów graficznych (Blackwell), połączeń wzajemnych (NVLink/Przełącznik NVLink), sieci (Spectrum-X/Spectrum-XGS, Quantum-X InfiniBand) po oprogramowanie (CUDA, TensorRT-LLM, mikrousługi NIM) NVIDIA utworzył zamkniętą pętlę obejmującą „oprogramowanie-connect-obliczeniowe” dla infrastruktury sztucznej inteligencji. Spectrum-XGS współdziała z NVLink, zapewniając trzy-skalowanie na trzech poziomach: wewnątrz-szafy (NVLink), wewnątrz-centrum danych-(Spectrum-X) i między-centrum danych- (Widmo-XGS).

Odpowiedzi konkurentów: Wcześniejsza technologia SUE firmy Broadcom ma podobne cele co Spectrum-XGS, a jej celem jest optymalizacja wydajności sieci Ethernet w celu wypełnienia luki w stosunku do technologii InfiniBand. Ponadto dostawcy tacy jak Arista, Cisco i Marvell przyspieszają działanie przełączników Ethernet-specjalizowanych dla sztucznej inteligencji, podczas gdy konkurencja koncentruje się na zgodności z ekosystemem pod względem wydajności-kosztu-.

Podstawową wartością Spectrum-XGS jest umożliwienie skalowania centrum danych AI z „ograniczeń jednej-lokacji” do „współpracy-regionalnej”. Ponieważ moc i teren stają się twardymi ograniczeniami dla pojedynczych centrów danych, superfabryki sztucznej inteligencji obejmujące-miasta i-kraje{5}}krajowe staną się podstawową formą obsługi aplikacji sztucznej inteligencji nowej-generacji (np. ogólnej sztucznej inteligencji,-klastrów agentów na dużą skalę).

Jak zapowiedział starszy wiceprezes działu sieci firmy NVIDIA, Gilad Shainer, na konferencji Hot Chips: „Certrum-danych-fizycznych sieci światłowodowych istnieje od dawna, ale algorytmy programowe takie jak Spectrum-XGS są kluczem do uwolnienia prawdziwej wydajności tych infrastruktur fizycznych”.